Was GEO eigentlich bedeutet

Wer in den letzten Jahren irgendwas mit SEO zu tun hatte weiß wie stabil die Grundregeln über Jahrzehnte geblieben sind. Gute Inhalte, ordentliche technische Basis, Backlinks aufbauen, Keywords platzieren. Das hat funktioniert. Lange. Zu lang vielleicht um den Wandel rechtzeitig zu erkennen der gerade stattfindet.

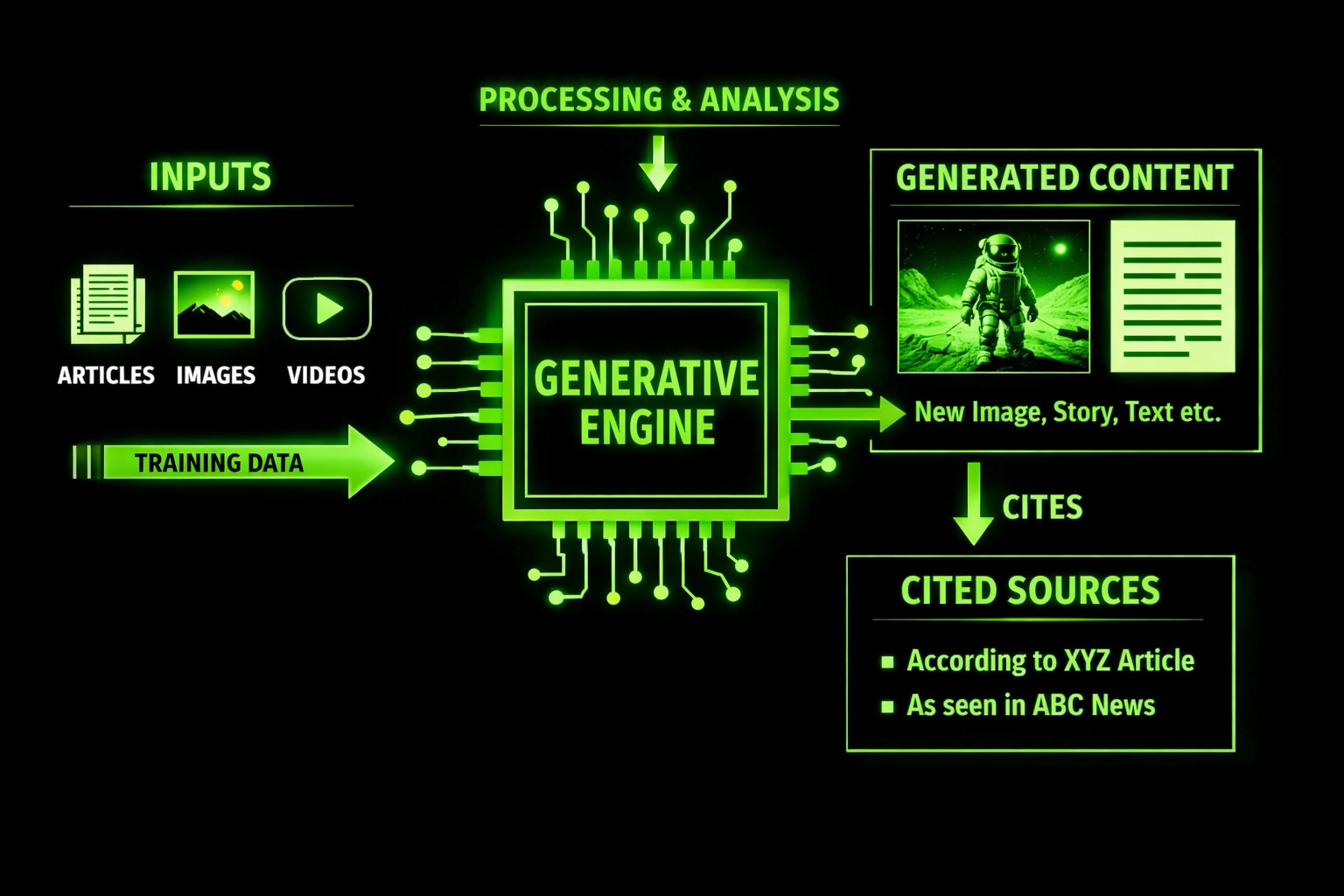

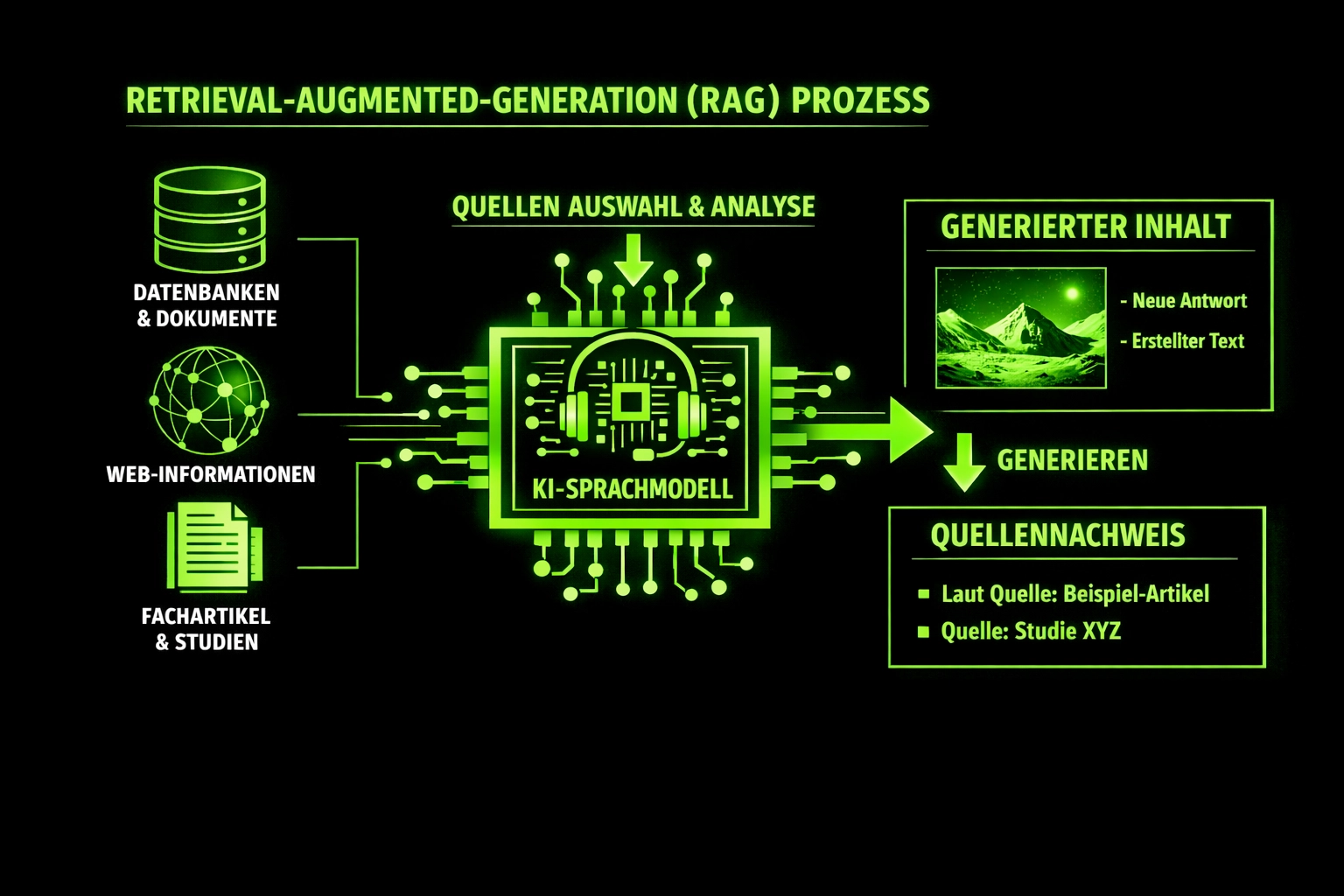

Generative Engine Optimization beschreibt das Optimieren von Inhalten für eine neue Art von Suchmaschinen: solche die keine Linkliste ausgeben, sondern eine direkte Antwort formulieren. ChatGPT, Perplexity, Google AI Overviews, Copilot. Der Nutzer fragt, die KI antwortet. Manchmal mit Quellenangabe, manchmal ohne. Die klassische blaue Ergebnisliste ist dabei oft gar nicht mehr sichtbar.

Der Begriff wurde als erstes wirklich wissenschaftlich greifbar durch eine Studie von Forschern der Princeton University, Georgia Tech und dem Allen Institute for AI, die im August 2024 auf der ACM KDD-Konferenz in Barcelona vorgestellt wurde. Ihr Paper trug schlicht den Titel "GEO: Generative Engine Optimization" und testete neun verschiedene Inhaltsstrategien an 10.000 Suchanfragen. Das Ergebnis war eindeutig: Wer Statistiken einbaut, glaubwürdige Quellen verlinkt und klar strukturiert schreibt, taucht in KI-generierten Antworten deutlich häufiger auf. Bis zu 40% mehr Sichtbarkeit war möglich, für schwächere Seiten sogar 115%.

Das klingt erstmal nach SEO wie immer. Ist es aber nicht ganz. Denn SEO optimiert für Klicks. GEO optimiert für Zitate. Das ist ein feiner, aber entscheidender Unterschied.